L’Autopilot de Tesla a été responsable de 736 accidents et de 17 décès, la plupart au cours de l’année dernière, selon les autorités

Les autorités affirment que l’Autopilot de Tesla a été responsable de 736 accidents et de 17 décès, la plupart des personnes sont mortes au cours de l’année dernière

/

La conduite entièrement autonome n’existe pas et n’existera peut-être jamais. Cependant, Tesla a lentement convaincu le monde, par le biais de son marketing, qu’elle l’était déjà. Les conséquences sont lourdes.

La voiture est perçue par certains comme une arme, ce qui est, en un mot, absurde. Une voiture est une voiture, pas une arme, et le fait qu’elle puisse tuer quelqu’un n’y change rien. Une brique, une circulaire ou une insuline ne sont pas non plus des armes et peuvent aussi, par une coïncidence malheureuse, tuer. Quoi qu’il en soit, conduire une voiture est une grande responsabilité et, de même qu’un médecin a besoin de qualifications approfondies pour prescrire de l’insuline, vous devez passer un examen de conduite avant de pouvoir légalement prendre le volant.

Le trafic routier s’est incroyablement intensifié au cours des dernières décennies, mais les examens n’ont pas beaucoup changé. Les questions de la partie théorique ont été mises à jour, mais il est toujours vrai qu’après quelques semaines de conduite aux côtés d’un instructeur, vous pouvez prendre la route en toute sécurité sans être accompagné. Il va probablement sans dire qu’à ce moment-là, vous courez un risque accru. Cependant, c’est votre responsabilité. Et les occasions ne manquent pas de perfectionner vos compétences au préalable, que ce soit sur les simulateurs ou sur les circuits de course.

Il est intéressant de noter que, bien que les politiciens parlent de plus en plus du fait que de nombreuses rues sont devenues des zones de guerre, leur pression pour développer les cours de conduite est pratiquement nulle. Les efforts en la matière ne sont limités que par les exigences législatives relatives à la présence de tel ou tel système d’assistance dans les nouvelles voitures. La sécurité devient donc peu à peu une patate chaude que les législateurs et les constructeurs se renvoient de main en main. Parallèlement, la concentration et la capacité des personnes qui dépendent de plus en plus des aides électroniques commencent à diminuer.

Si ces béquilles fonctionnaient cent pour cent du temps, cent pour cent du temps, il n’y aurait pas grand-chose à objecter à une telle démarche. Mais nous savons par expérience qu’elles sont très faillibles, et s’y fier dans tous les sens du terme, c’est jouer avec le feu. Les systèmes de conduite autonome vont encore plus loin, et ils s’accompagnent d’une accalmie certaine.

Jusqu’à présent, aucun constructeur n’a mis au point un pilote automatique qui vous permette de vous installer sur le siège arrière et d’y dormir en toute tranquillité ; personne n’ose le faire. Pourtant, on trouve d’innombrables exemples de ce type sur Internet, principalement en rapport avec Tesla. En fait, cette dernière a décidé de semer encore plus la confusion dans l’esprit du public en baptisant ses systèmes semi-autonomes Autopilot ou Full Self-Driving. Et ce, bien qu’il n’y ait pas de véritable autopilote ou conduite autonome.

Cela fait des années que nous soulignons les risques encourus, mais les autorités n’ont commencé à agir que récemment. Tesla a fait l’objet d’une enquête de la NHTSA, une association qui veille à la sécurité sur les routes américaines. Les résultats de l’enquête ne sont pas du tout favorables à la marque. En effet, avant cette analyse, seuls trois décès étaient liés à l’Autopilot. Or, en moins de douze mois, la technologie s’est retrouvée à l’origine de 736 accidents qui ont tué 17 personnes, dont onze depuis mai 2022.

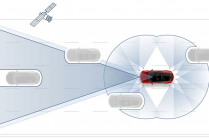

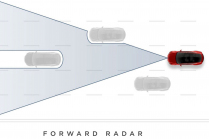

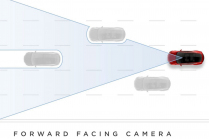

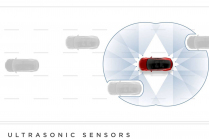

La NHTSA voit plusieurs facteurs derrière l’augmentation du nombre de décès. L’un d’entre eux est la volonté des constructeurs automobiles d’économiser de l’argent. En 2021, Elon Musk a décidé que si les gens n’avaient besoin que d’yeux, les voitures qu’il protégeait avaient besoin de caméras. Il y a donc eu une élimination des radars et des capteurs, ce qui a rendu l’efficacité du système bien pire. En outre, Tesla a également fait de la technologie de l’auto-conduite intégrale une vache à lait, qui est passée de 12 000 voitures au départ à près de 400 000 voitures en un an seulement.

En attendant, les deux systèmes de la marque sont encore en cours d’élaboration. Bien qu’il soit agréable qu’un constructeur automobile mentionne quelque chose comme cela dans tous les manuels, il peut légalement s’en laver les mains, mais il doit savoir qu’il est moralement responsable de ce que les gens font avec ces voitures anti-autopilotage. Les capacités momentanées des systèmes peuvent être impressionnantes, mais au quotidien, il y a des millions de nouvelles situations qui se présentent. En tant que conducteur, vous devez gérer non pas 99,9 ou 99,99 % d’entre elles, mais toutes, car même la dernière situation imaginable peut tuer. Les humains peuvent généralement y faire face, curieusement, mais les systèmes semi-autonomes en sont loin. Si vous les essayez, vous verrez qu’ils essaieront de vous tuer au moins une fois par jour, même si ce n’est pas intentionnel.

L’Autopilot et l’Autoconduite intégrale peuvent donc être comparés à un élève d’auto-école qui a déjà maîtrisé un tour de piste sur le terrain d’entraînement. Toutefois, cela ne signifie pas qu’il sait déjà conduire, et il peut donc oublier la conduite autonome en ville. Mais nous ne comprenons toujours pas pourquoi les voitures dotées de systèmes autonomes imparfaits sont autorisées à circuler. Surtout que Tesla a gagné 280 milliards de couronnes rien que l’année dernière, ce qui aurait été suffisant pour construire une ville d’entraînement fictive et payer les extras.

L’enquête de la NHTSA est en cours, mais même les résultats obtenus jusqu’à présent devraient suffire aux législateurs pour empêcher les constructeurs automobiles de faire des lapins d’essai des citoyens pour beaucoup d’argent. Cependant, nous avons le sentiment que rien de tel ne se produira. Nous nous attendons plutôt à ce que Tesla passe à la contre-attaque et annonce l’excuse classique « l’Autopilot n’était pas actif au moment de l’accident ». Oui, il s’est éteint juste avant le moment où il a mis la voiture dans une situation déjà inextricable.

Si les autorités ne laissent pas une personne n’ayant pas les compétences requises conduire sur la voie publique, elles devraient adopter la même approche pour la conduite autonome. Mais dans le cas des systèmes de Tesla, le transfert opportuniste de la responsabilité au conducteur suffit. Photo : Tesla

The Washington Post

Tous les articles sur Autoforum.cz sont des commentaires exprimant l’opinion de la rédaction ou de l’auteur. À l’exception des articles marqués comme étant de la publicité, le contenu n’est pas sponsorisé ou influencé de quelque manière que ce soit par des tiers.